ในอดีต เราเคยมองว่าระบบ ERP คือเครื่องมือบันทึกข้อมูล และมองว่า GRC (Governance, Risk, Compliance) คือ “เบรก” ที่คอยหยุดยั้งความเร็วของธุรกิจเพื่อความปลอดภัย แต่ในยุคที่ปัญญาประดิษฐ์ถูกออกแบบมาเป็นแกนกลางของระบบหรือ AI Native มุมมองนี้กำลังถูกท้าทาย เพราะเมื่อ AI ผสานเข้ากับ ERP และ GRC อย่างสมบูรณ์ มันจะไม่ใช่แค่การควบคุม แต่คือการสร้าง Value Creation หรือมูลค่ามหาศาลที่องค์กรแบบดั้งเดิมทำไม่ได้

จุดเปลี่ยนจาก Passive สู่ Intelligent GRC: เมื่อระบบเริ่ม “คิด” แทนการ “รอ”

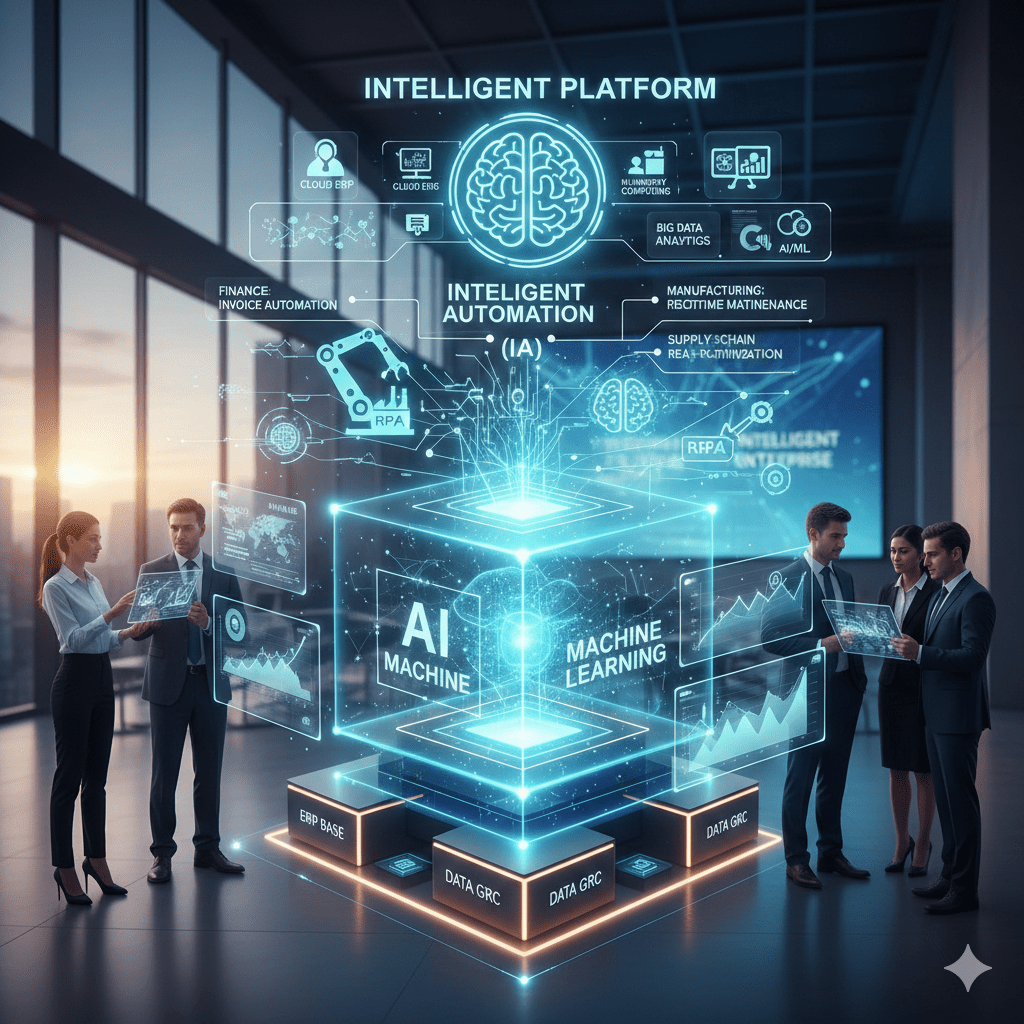

ความแตกต่างที่สำคัญที่สุดของระบบแบบ AI Native คือการเปลี่ยนผ่านจากระบบตั้งรับ (Passive) ไปสู่ระบบอัจฉริยะ (Intelligent)

โดยปกติ ERP แบบเดิมจะทำหน้าที่เป็นเพียง “ถังเก็บข้อมูล” ที่รอให้พนักงานป้อนค่าลงไป แล้วทีม GRC หรือ Internal Audit ค่อยมาสุ่มตรวจย้อนหลัง ซึ่งมักจะพบปัญหาเมื่อความเสียหายเกิดขึ้นไปแล้ว แต่ระบบ AI Native จะเปลี่ยน “ข้อมูลที่อยู่นิ่ง” ให้กลายเป็น “กระแสข้อมูลที่ไหลเวียน” ระบบจะเฝ้าสังเกตพฤติกรรม (Pattern Recognition) ตลอดเวลา เช่น หากมีการสร้าง Vendor ใหม่ที่มีเลขบัญชีซ้ำกับพนักงานในระบบ ระบบจะระงับและแจ้งเตือนทันทีก่อนที่จะเกิดการโอนเงินจริง นี่คือการเปลี่ยน GRC ให้กลายเป็นส่วนหนึ่งของลมหายใจในธุรกิจที่ทำงานในระดับวินาที

3 เสาหลักของการสร้างมูลค่า: GRC ในฐานะคันเร่งธุรกิจ

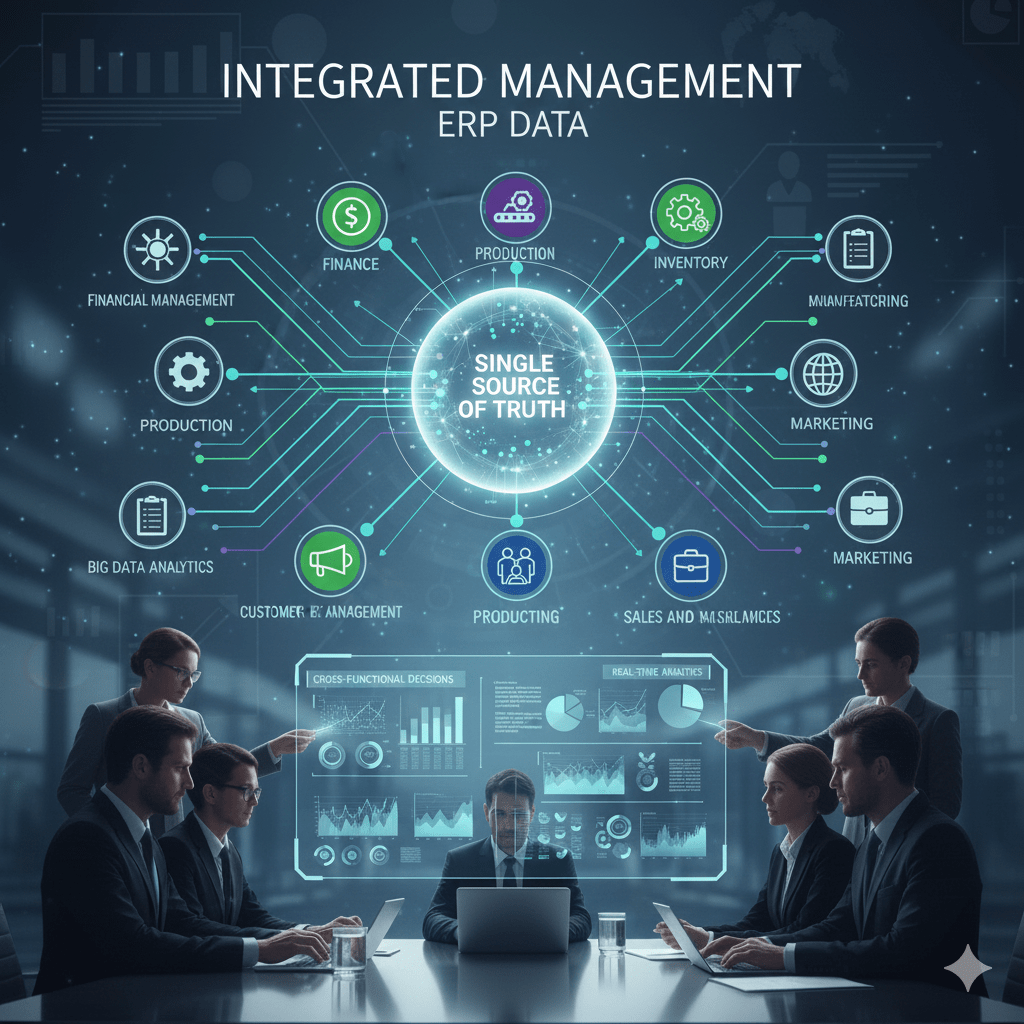

การมี GRC ที่ฉลาดส่งผลโดยตรงต่อการสร้างมูลค่าใน 3 มิติหลักที่ผู้บริหารให้ความสำคัญ:

- มิติด้านต้นทุนและความสูญเสีย (Cost Efficiency): มูลค่าที่เห็นชัดที่สุดคือการลด “รั่วไหล” AI จะตรวจจับความผิดปกติ (Anomaly Detection) เช่น การจ่ายเงินซ้ำซ้อน การเบิกจ่ายที่ผิดนโยบาย หรือแม้แต่การทุจริตในรูปแบบใหม่ๆ ได้แม่นยำกว่าการสุ่มตรวจด้วยมนุษย์ นอกจากนี้ยังลดต้นทุนในกระบวนการ Audit ที่เคยต้องใช้เวลาและคนจำนวนมาก ให้เหลือเพียงการตรวจสอบ “สิ่งที่ระบบคัดกรองมาให้แล้ว”

- มิติด้านความเร็วและโอกาส (Speed & Agility): หลายองค์กรพลาดโอกาสทางธุรกิจเพราะขั้นตอนการอนุมัติที่ล่าช้าเนื่องจากกังวลเรื่องความเสี่ยง แต่ด้วย AI Native GRC ระบบสามารถ “อนุมัติเบื้องต้น” ตามเงื่อนไขความเสี่ยงที่กำหนดไว้ได้ทันที ทำให้ธุรกิจเคลื่อนที่ได้เร็วขึ้นโดยไม่หลุดกรอบการควบคุม

- มิติด้านความเชื่อมั่น (Trust as a Currency): ในตลาดระดับโลก ความน่าเชื่อถือคือมูลค่า องค์กรที่มีระบบ GRC โปร่งใส ตรวจสอบได้ทันที (Real-time Traceability) จะได้รับความไว้วางใจจากคู่ค้าและหน่วยงานกำกับดูแล ซึ่งเป็นใบเบิกทางสำคัญในการขยายตลาดและเพิ่มมูลค่าหุ้นของบริษัท

Cybersecurity & Resilience: การรักษาขุมทรัพย์ด้วยวงจร PDCA อัจฉริยะ

Value Creation ที่เราสร้างมาทั้งหมดอาจกลายเป็นศูนย์ในพริบตาหากระบบ ERP ถูกโจมตีทางไซเบอร์ ในยุค AI Native การสร้างความยืดหยุ่น (Resilience) จึงต้องเปลี่ยนจากการ “ทำแผนสำรองบนกระดาษ” มาเป็นการใช้ PDCA ในระดับอัลกอริทึม:

- Plan (วางแผน): AI จะไม่ได้แค่เก็บ Backup แต่จะช่วย “จำลองสถานการณ์” (Simulation) เพื่อหาจุดอ่อนที่สุดของระบบ และวางแผนกู้คืน (Recovery Plan) ที่ปรับเปลี่ยนตามความสำคัญของข้อมูลในเวลานั้น

- Do (ปฏิบัติ): ระบบจะตอบสนองโดยอัตโนมัติ (Automated Response) หากตรวจพบการบุกรุก เช่น การกักกัน User ที่มีพฤติกรรมเสี่ยง หรือการตัดการเชื่อมต่อในส่วนที่ติดเชื้อทันทีเพื่อไม่ให้ลามไปยังส่วนอื่น โดยไม่ต้องรอการอนุมัติจากมนุษย์ที่อาจใช้เวลานานเกินไป

- Check (ตรวจสอบ): ระบบจะทำการ “ซ้อมกู้คืนข้อมูล” (Restoration Test) แบบเงียบๆ ในเบื้องหลังทุกวัน เพื่อยืนยันว่าหากเกิดเหตุจริง ข้อมูลจะกลับมาใช้งานได้ตามเวลาที่สัญญาไว้ (RTO/RPO)

- Act (ปรับปรุง): เมื่อเกิด Incident แม้เพียงเล็กน้อย AI จะเรียนรู้และปรับนโยบายการป้องกันใหม่ทันที ทำให้ “กำแพง” ขององค์กรแข็งแกร่งขึ้นทุกครั้งที่มีคนพยายามจะพังเข้ามา

ในฐานะที่ปรึกษาด้านบริหารและการตรวจสอบภายใน สิ่งที่ผมอยากฝากไว้คือ AI ไม่ใช่ผู้วิเศษที่จะเนรมิตทุกอย่างได้เพียงชั่วข้ามคืน ความสำเร็จของ AI Native ERP และ GRC ขึ้นอยู่กับ “ความสะอาดของข้อมูล” (Data Integrity) และ “ทัศนคติของคน” เราต้องเปลี่ยนจากคน “ทำงานตามสั่ง” มาเป็น “ผู้กำกับระบบ” (Orchestrator) ที่นำข้อมูลจาก AI มาตัดสินใจเชิงกลยุทธ์ หากองค์กรเริ่มจากจุดเล็กๆ ที่เห็นผลชัด (Quick Win) เช่น การคุมความเสี่ยงในระบบจัดซื้อ หรือระบบการเข้าถึงข้อมูลสำคัญ ท่านจะพบว่า GRC ไม่ใช่ภาระที่ต้องจ่าย แต่คือการลงทุนที่คืนกำไร ในรูปแบบของความมั่นคง ความเร็ว และความมั่งคั่งที่ยั่งยืนขององค์กรอย่างแท้จริง

โพสต์โดย Metha Suvanasarn

โพสต์โดย Metha Suvanasarn